3S Market deliver Smart and Valuable information for Business 3S Market 傳遞 智慧應用與價值的商業資訊 Facial Recognition: What...

3S Market 是台灣物聯網資訊、安全監控,與雲端智慧整合應用解決方案的人氣布落格網站,在公共、工商與居家三大應用領域中,提供產品、產業、市場以及行業垂直應用領域的資訊平台。 Smart、Solutions、Strategy 是3S Market 提供給智慧應用產業的核心價值。

3S Market deliver Smart and Valuable information for Business 3S Market 傳遞 智慧應用與價值的商業資訊 Facial Recognition: What...

台灣電信工程公會@Secutech 2019 科寶電子官網 www.cop-security.com 3S MARKET 施正偉 很多人都說,現在很多展覽都辦不起來,是因為網路資訊太發達了。坦白說,我完全不認同這樣的說法…… 照...

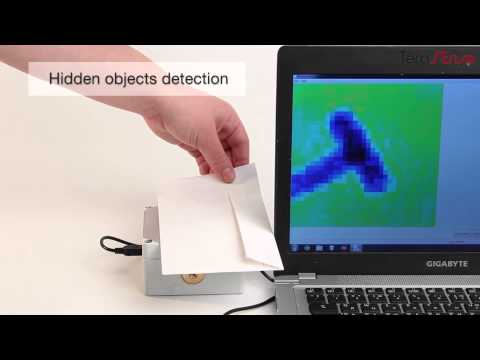

TeraSense terahertz imaging camera 康橋科技 —— 白光攝影機專業廠商! 來源 : 微迷网 據麥姆斯咨詢報導,英國達勒姆大學(University of Durham)的研究人員,創建了一種新的成像系統,該系統在...

Google Keynote (Google I/O'19) AKD 零售櫃檯專用監視攝影機 來源: 镁客网 一年一度的Google I / O 大會在山景城拉開帷幕。 在這場將近兩小時的keynote上,谷歌深...