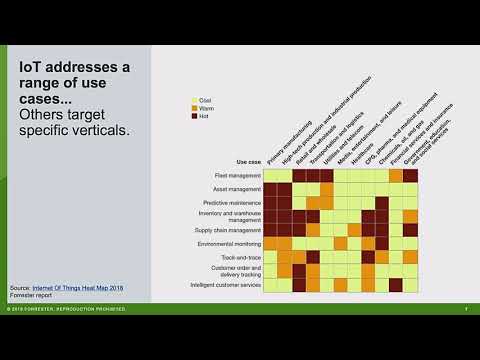

3S Market 傳遞 智慧應用與價值的商業資訊 IoT Predictions for 2019 and Beyond: Data at the Heart of Your IoT Strategy ...

3S Market 是台灣物聯網資訊、安全監控,與雲端智慧整合應用解決方案的人氣布落格網站,在公共、工商與居家三大應用領域中,提供產品、產業、市場以及行業垂直應用領域的資訊平台。 Smart、Solutions、Strategy 是3S Market 提供給智慧應用產業的核心價值。

3S Market 傳遞 智慧應用與價值的商業資訊 IoT Predictions for 2019 and Beyond: Data at the Heart of Your IoT Strategy ...

The 7 Biggest Technology Trends In 2020 Everyone Must Get Ready For Now 智慧安控專區,展覽報名聯絡人: 0935-970-603 施正偉 ...

Internet of Things (IoT) Architecture :IoT Tutorial for Beginners 智慧安控專區,展覽報名聯絡人: 0935-970-603 施正偉 ...

20BN Hypermodel Demo: Real-Time Human Behavior Understanding with Deep Learning 智慧安控專區,展覽報名聯絡人: 0935-970-603 施正偉 ...